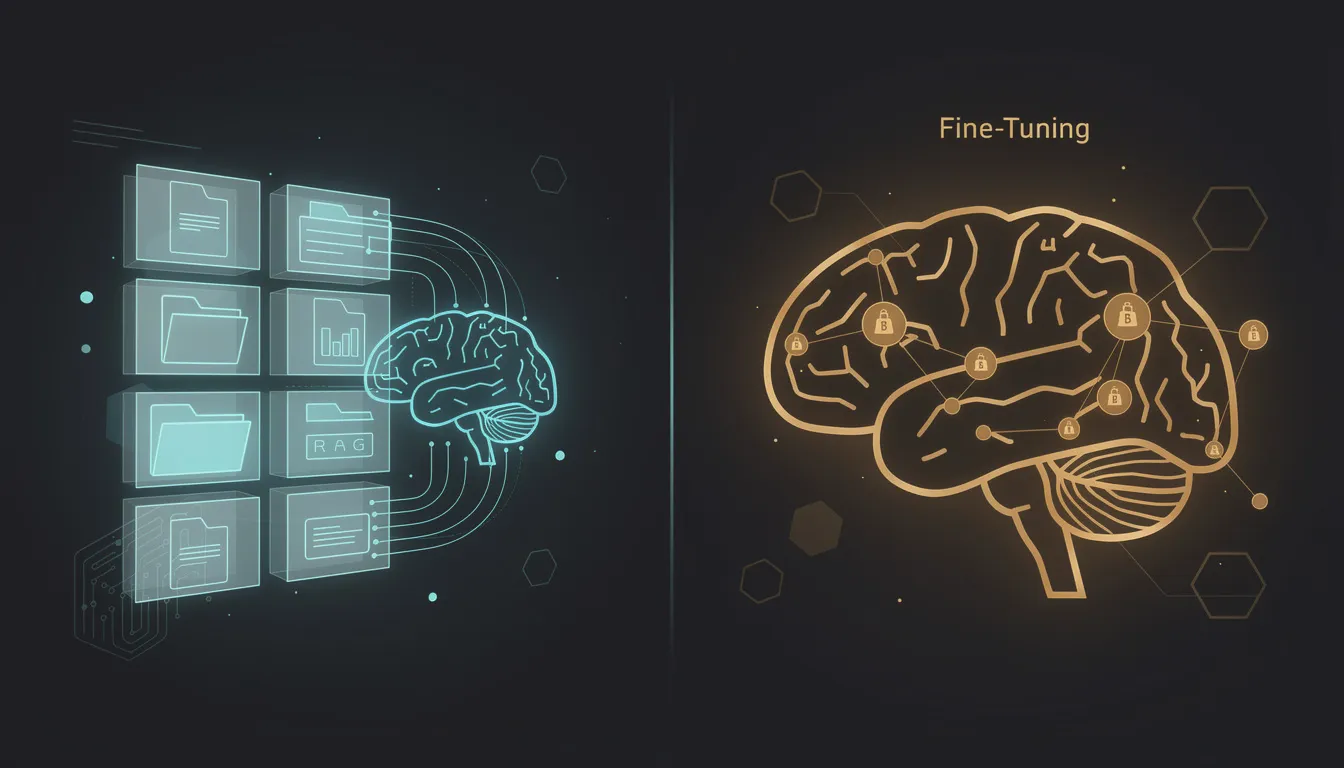

RAG vs Fine-Tuning : Quelle approche choisir pour votre LLM ?

RAG et fine-tuning sont deux approches légitimes pour construire des produits propulsés par des LLMs. Elles résolvent des problèmes fondamentalement différents. Choisir la mauvaise fait perdre des mois — pas parce que l'implémentation échoue complètement, mais parce qu'on se retrouve avec un système qui fonctionne techniquement mais ne résout pas le vrai problème qu'on voulait adresser.

Ce guide explique clairement les deux approches, identifie quand chacune est appropriée, et vous donne un framework en quatre questions pour prendre la bonne décision avant de vous engager dans une architecture.

Comment fonctionnent les LLMs par défaut

Pour comprendre quand RAG et fine-tuning sont utiles, il est utile de comprendre d'abord les limitations des LLMs de base.

Un grand modèle de langage comme GPT-4 est entraîné sur un corpus massif de texte provenant d'Internet, de livres et d'autres sources. Ce processus d'entraînement ancre une représentation de la connaissance mondiale dans les paramètres du modèle — des milliards de poids qui encodent des relations entre concepts, faits et patterns linguistiques.

Cela crée trois limitations importantes :

La coupure de connaissance. Le modèle ne sait rien des événements ou documents postérieurs à sa date de coupure d'entraînement. Si votre cas d'usage implique des informations récentes — tarifs actuels, changements réglementaires récents, nouvelle documentation produit — le modèle de base ne les aura pas.

Aucun accès aux données privées. Votre base de connaissances interne, les données de vos clients, les documents de votre entreprise — rien de tout cela n'était dans le corpus d'entraînement. Un LLM de base n'a aucune connaissance de votre domaine spécifique, de votre produit ou de vos clients. Pour des entreprises au Maroc qui ont des processus et une documentation spécifiques, c'est particulièrement important.

Risque d'hallucination. Quand un modèle ne sait pas quelque chose, il génère souvent une réponse plausible de toute façon. Dans un contexte grand public, c'est ennuyeux. Dans un contexte B2B impliquant des informations juridiques, médicales, financières ou critiques pour le produit, c'est un problème sérieux.

RAG et fine-tuning adressent ces limitations de manières différentes. Comprendre quelle limitation vous cherchez principalement à résoudre vous dit quelle approche utiliser.

Qu'est-ce que RAG et quand l'utiliser ?

Retrieval-Augmented Generation est un pattern où, au lieu de se reposer uniquement sur ce que le modèle a mémorisé, vous récupérez des informations pertinentes depuis une source de connaissance externe au moment de la requête et les incluez dans le prompt comme contexte.

Comment fonctionne RAG

L'implémentation comporte trois étapes :

Indexation : Vos documents (PDFs, pages web, enregistrements de base de données, articles d'aide, wikis internes) sont découpés en morceaux plus petits — typiquement 300 à 1500 tokens chacun. Chaque morceau est converti en vecteur numérique (un embedding) à l'aide d'un modèle d'embedding. Ces vecteurs sont stockés dans une base de données vectorielle aux côtés du texte original.

Récupération : Quand un utilisateur pose une question, la question est également convertie en embedding avec le même modèle. La base de données vectorielle trouve les morceaux stockés dont les embeddings sont les plus similaires à l'embedding de la requête (mesurés par similarité cosinus ou produit scalaire). Les k morceaux les plus pertinents sont récupérés.

Génération : Les morceaux récupérés sont insérés dans le prompt envoyé au LLM : "Sur la base du contexte suivant : [morceaux récupérés], répondez à cette question : [requête utilisateur]." Le modèle génère une réponse ancrée dans le contenu récupéré plutôt que uniquement dans ses paramètres entraînés.

Quand RAG est le bon choix

Données dynamiques ou fréquemment mises à jour. Si votre base de connaissances change régulièrement — tarification produit, informations sur les membres de l'équipe, inventaire actuel, actualités récentes, réglementations qui évoluent au Maroc — RAG est la bonne approche. Vous mettez à jour l'index vectoriel quand les données changent, et les réponses du modèle reflètent immédiatement ces mises à jour. Pas de réentraînement nécessaire.

Documents propriétaires et connaissances internes. La documentation interne de votre entreprise, les contrats clients, l'historique des tickets de support, les playbooks de vente — ces données ne peuvent jamais être dans le corpus d'entraînement d'un modèle de base. RAG est le seul moyen de donner au modèle accès à celles-ci.

Quand la précision et l'auditabilité comptent. RAG vous permet de montrer à l'utilisateur quels documents sources ont été utilisés pour générer une réponse. C'est critique dans des domaines où les utilisateurs doivent vérifier les affirmations — juridique, médical, conformité, conseil financier. Le modèle peut même citer directement depuis le texte récupéré, rendant les réponses auditables.

Quand vous avez des données d'entraînement limitées. Le fine-tuning nécessite un ensemble de données significatif d'exemples de haute qualité. RAG n'a pas cette exigence — si vous avez les documents, vous pouvez construire l'index.

Limitations de RAG

La qualité de la récupération est un plafond. Si le bon morceau n'est pas récupéré, le modèle ne peut pas générer une réponse correcte quelle que soit sa capacité. Une mauvaise stratégie de chunking, des modèles d'embedding faibles ou des requêtes trompeuses peuvent toutes causer des échecs de récupération. Évaluer et améliorer la qualité de récupération est une tâche d'ingénierie continue.

Latence. RAG ajoute au moins un appel API supplémentaire (la recherche vectorielle) et augmente la longueur des prompts. Pour les applications haute fréquence ou sensibles à la latence, cette surcharge compte.

Contraintes de fenêtre de contexte. Vous ne pouvez récupérer qu'un nombre limité de morceaux avant que le prompt ne dépasse la fenêtre de contexte du modèle. Pour des requêtes très larges touchant de nombreux documents, RAG peut avoir du mal.

Qu'est-ce que le fine-tuning et quand l'utiliser ?

Le fine-tuning est le processus de prendre un modèle pré-entraîné et de continuer à l'entraîner sur un ensemble de données plus petit et spécifique à un domaine. Les paramètres du modèle sont mis à jour sur la base de vos exemples, et le résultat est un modèle qui se comporte différemment — souvent mieux pour votre cas d'usage spécifique — que le modèle de base.

Comment fonctionne le fine-tuning

Vous préparez un ensemble de données de paires entrée-sortie qui représentent le comportement voulu. Pour un bot de support, ce pourraient être des paires de questions clients et de réponses idéales. Pour un outil de rédaction de documents, ce pourraient être des paires d'instructions brèves et de documents entièrement rédigés.

Cet ensemble de données est utilisé dans un processus d'entraînement (supervised fine-tuning) où les poids du modèle sont ajustés pour minimiser la différence entre ses sorties et les sorties "correctes" dans votre ensemble de données. L'API de fine-tuning d'OpenAI rend cela accessible sans nécessiter d'infrastructure ML — vous uploadez votre dataset, lancez un job de fine-tuning, et recevez un ID de modèle personnalisé une fois terminé.

Quand le fine-tuning est le bon choix

Format de sortie cohérent. Si votre application exige que le modèle retourne toujours une structure spécifique — un objet JSON avec des clés exactes, un document selon un modèle particulier, une réponse suivant une formule précise — le fine-tuning enseigne ce format de façon fiable. Le prompt engineering peut y parvenir partiellement, mais le fine-tuning y parvient de façon plus cohérente et à un coût de tokens inférieur par appel.

Ton, style ou voix spécifiques. Si votre produit exige que le modèle écrive dans une voix de marque particulière, communique avec une persona spécifique, ou corresponde au style de votre contenu existant, le fine-tuning sur des exemples de ce style l'enseigne bien plus efficacement que des instructions dans le prompt.

Vocabulaire de domaine spécialisé. Dans des domaines très spécialisés — codification médicale, rédaction juridique, analyse financière, documentation d'ingénierie — le modèle de base peut utiliser une terminologie imprécise ou manquer des conventions spécifiques au domaine. Le fine-tuning sur des exemples d'experts améliore cela. Pour des contextes marocains spécifiques — droit des affaires local, terminologie réglementaire AMMC ou Bank Al-Maghrib — le fine-tuning peut apporter une valeur réelle.

Optimisation des coûts et de la latence. Un modèle plus petit fine-tuné (comme GPT-4o-mini) peut souvent égaler la qualité d'un modèle de base plus grand sur une tâche spécifique, à une fraction du coût par token. Pour les applications à haut volume où le même type de requête tourne des milliers de fois par jour, c'est significatif.

Limitations du fine-tuning

Il ne résout pas les problèmes de connaissance. C'est l'idée reçue la plus courante. Le fine-tuning enseigne au modèle comment se comporter, pas quoi savoir. Si vous fine-tunez un modèle sur votre documentation de support, il apprendra le ton et le format de ces réponses — mais il hallucinera toujours des faits sur votre produit quand il sera interrogé sur des sujets non couverts dans ses données d'entraînement. Le fine-tuning n'est pas un substitut à RAG quand l'objectif est la précision factuelle sur des données dynamiques.

Exigences en données. Un fine-tuning efficace nécessite typiquement des centaines à des milliers d'exemples de haute qualité. Collecter et labelliser ces données n'est pas trivial.

Coût d'entraînement et durée du cycle. Un run de fine-tuning sur l'API d'OpenAI pour un dataset significatif coûte dans la fourchette 50-500$ selon la taille du dataset. Plus important encore, le cycle préparer les données → entraîner → évaluer → ajuster → réentraîner est lent. Pour un produit qui évolue encore, les cycles de fine-tuning peuvent ralentir considérablement l'itération.

Pas de mises à jour de connaissance en temps réel. Une fois entraîné, un modèle fine-tuné ne sait pas ce qui a changé dans vos données. Chaque mise à jour de connaissance nécessite un nouveau run d'entraînement.

Le framework de décision

Passez votre cas d'usage par ces quatre questions :

1. Le défi principal est-il que le modèle manque de connaissance d'informations spécifiques ? Si oui — le modèle doit connaître vos produits, vos documents, des événements récents, les données de vos clients — utilisez RAG. Le fine-tuning ne résoudra pas un problème de connaissance.

2. Le défi principal est-il un comportement, un style ou un format de sortie incohérent ? Si oui — le modèle écrit dans le mauvais ton, ignore les exigences de formatage, ou produit des sorties structurellement incohérentes — envisagez le fine-tuning. RAG n'améliore pas la cohérence comportementale.

3. Les données changent-elles fréquemment ? Si oui, utilisez RAG. Fine-tuner un modèle chaque fois que votre documentation est mise à jour n'est pas opérationnellement faisable.

4. Avez-vous des centaines d'exemples labellisés de haute qualité ? Si non, commencez par RAG plus un prompt engineering soigneux. Le fine-tuning sans données suffisantes de haute qualité va probablement sous-performer un modèle de base bien prompté.

L'approche hybride

Pour les produits IA matures, les deux approches sont souvent complémentaires plutôt que mutuellement exclusives.

Fine-tuner pour le comportement, RAG pour la connaissance. Fine-tuner votre modèle pour répondre dans le bon format, ton et vocabulaire de domaine. Puis utiliser RAG pour lui fournir les informations spécifiques dont il a besoin pour répondre avec précision. C'est courant dans les déploiements enterprise où la cohérence de la sortie (une exigence de conformité) et la précision sur des données dynamiques sont toutes deux requises.

Un exemple pratique applicable au contexte marocain : un outil de rédaction de documents juridiques pour le droit des affaires marocain. Fine-tuner sur des exemples de documents juridiques bien structurés en droit marocain — cela enseigne au modèle la structure correcte des documents, la phraséologie juridique appropriée et le ton professionnel. Puis utiliser RAG pour récupérer les lois spécifiques, les précédents et les clauses contractuelles pertinents pour le document actuel. Le modèle fine-tuné produit une sortie correctement structurée ; le contexte récupéré la rend précise.

Cette combinaison est plus complexe et coûteuse à construire et à maintenir, mais c'est l'architecture que les applications LLM spécialisées les plus performantes utilisent.

Idées reçues courantes sur chaque approche

"Le fine-tuning va faire connaître nos données propriétaires au modèle." Non. Il va faire en sorte que le modèle se comporte comme vos données propriétaires, ce qui est différent. Il ne stocke pas de façon fiable des informations factuelles — il stocke des patterns comportementaux. Utilisez RAG pour la récupération factuelle.

"RAG n'est qu'un contournement en attendant que le fine-tuning s'améliore." Non. RAG est la bonne architecture pour toute application qui doit répondre en se basant sur des informations dynamiques, privées ou fréquemment mises à jour. Même si les capacités des LLMs s'améliorent, RAG remplit une fonction différente du fine-tuning et restera pertinent.

"Nous avons besoin de beaucoup de données avant de pouvoir utiliser l'IA dans notre produit." Pour le fine-tuning, oui. Pour RAG, la barrière est bien plus basse — si vous avez de la documentation, vous avez assez pour commencer. Un index vectoriel de 50 articles d'aide bien écrits est suffisant pour construire un assistant de support utile.

"Le fine-tuning est toujours moins cher que le prompting." Parfois, mais seulement à l'échelle. Le coût de la collecte de données, des runs d'entraînement et de la maintenance continue est substantiel. Pour la plupart des produits en phase initiale, un prompting optimisé avec un modèle de base solide est à la fois moins cher et plus rapide à itérer.

Le bon choix entre RAG et fine-tuning se résume à : résolvez-vous un problème de connaissance ou un problème de comportement ? La plupart des fonctionnalités IA B2B sont des problèmes de connaissance. La plupart commencent par RAG — et ajoutent le fine-tuning seulement quand la cohérence comportementale devient un goulot d'étranglement.

En tant que développeur freelance spécialisé en IA basé à Casablanca, je travaille avec ces deux approches pour des clients au Maroc et à l'international. Si vous concevez une fonctionnalité propulsée par LLM et souhaitez réfléchir à l'architecture ensemble, je propose un appel de consultation IA gratuit.

Réservez votre consultation IA gratuite avec Mehdi Yatrib sur yatrib.me

Written by Mehdi Yatrib — Indie Maker & Consultant based in Casablanca, Morocco.

Work with me on Artificial Intelligence